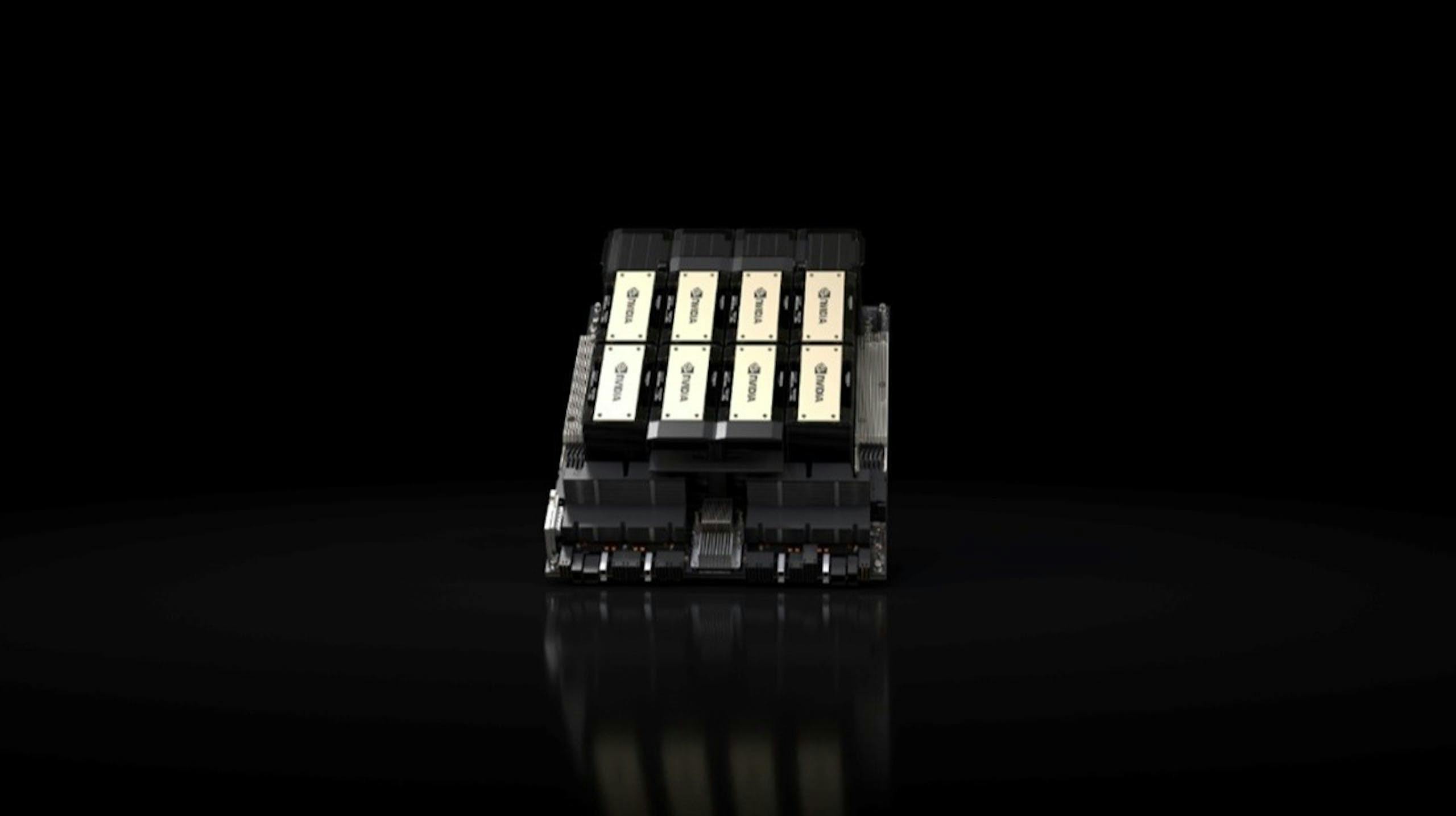

雖然NVIDIA甫在GTC 2024公布眾所矚目的全新Blackwell架構,但畢竟Blackwell仍要待到2024年下半年才會開始出貨,故目前最新的NVIDIA AI GPU加速產品為採用美光HBM3e記憶體的NVIDIA H200 Tensor Core GPU;NVIDIA公布全新的MLPerf測試成績,基於Hopper架構的H100借助TensorRT-LLM軟體突破MLPerf的生成式AI測試項突破原本的性能上限,於GPT-J LLM推論性能較6個月前提升近3倍,而陸續出貨的H200 GPU則透過容量、頻寬提升的HBM3e記憶體與更彈性的散熱,一舉刷新多項MLPerf的紀錄。▲包括...

| 時間 | 分享(原讚與享) | 評論 | 回應(讚與心情) | 外掛評論 |

|---|